Une attaque d’IA peut capter les voix de microphones MEMS

Des chercheurs américains et japonais ont identifié un risque de sécurité avec les microphones MEMS utilisés dans les ordinateurs portables et les assistants intelligents tels que Google Home.

Ces composants MEMS présentent une vulnérabilité qui permet de détecter les émissions électromagnétiques, même à travers un mur, en utilisant l’IA pour reconstituer les voix captées par le microphone.

Les chercheurs de l’université de Floride et de l’université d’électro-communication du Japon ont également identifié plusieurs moyens de remédier à ce défaut de conception et déclarent avoir partagé leurs travaux avec les fabricants afin de trouver des solutions potentielles pour l’avenir, en recommandant comme moyen de défense l’utilisation d’une horloge à étalement de spectre.

Les chercheurs ont testé le MP34DT01-M de STMicroelectronics, le SPM0405 de Knowles (qui fait maintenant partie de Synaptics), les TDK Invensense CS-41350 et T3902 et le Vesper VM3000 qui fait maintenant partie de Qualcomm. Tous ont été contactés pour commentaires

« Avec un récepteur radio FM et une antenne en cuivre, vous pouvez écouter ces microphones. C’est dire à quel point cela peut être facile », a déclaré le professeur Sara Rampazzi de l’université de Floride. « Cela ne coûte qu’une centaine de dollars, voire moins.

Chaque harmonique des impulsions numériques utilisées dans les microphones MEMS conserve les informations acoustiques, ce qui permet de retrouver le son original par une simple démodulation FM à l’aide de récepteurs radio standard et d’une simple antenne. Un pirate peut exploiter cette vulnérabilité pour capturer ce que le microphone MEMS entend à distance sans installer de logiciel malveillant ou altérer l’appareil.

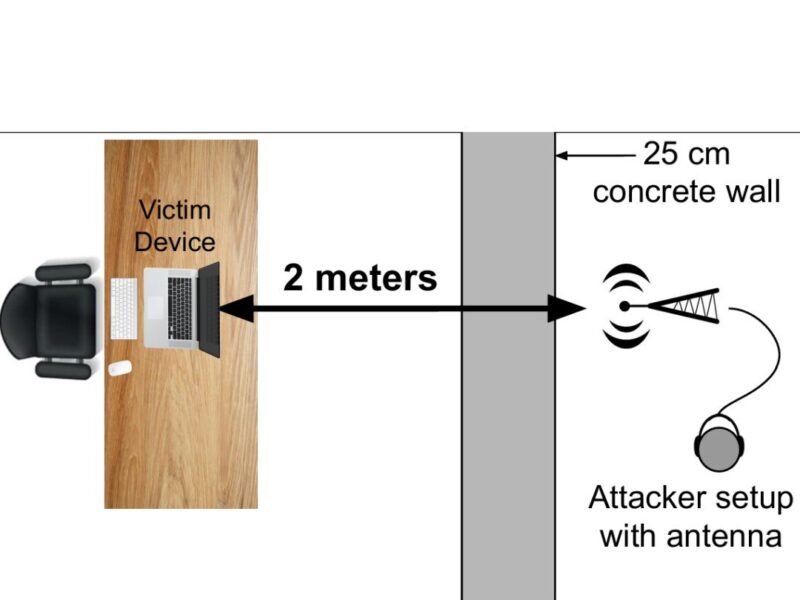

Les chercheurs ont utilisé des enregistrements standardisés de phrases aléatoires pour tester l’attaque, en testant la technique à travers des murs de différentes épaisseurs.

L’attaque atteint une précision de 94,2 % dans la reconnaissance des chiffres prononcés, jusqu’à 2 mètres d’un ordinateur portable situé derrière un mur de béton de 25 cm. L’IA générative d’OpenAI a été utilisée pour reconstruire la voix avec un taux d’erreur de transcription aussi bas que 6,5 %

Les chercheurs ont testé une série d’ordinateurs portables, le haut-parleur intelligent Google Home et des casques utilisés pour les vidéoconférences. L’écoute a mieux fonctionné sur les ordinateurs portables, en partie parce que leurs microphones étaient reliés à de longs fils qui servaient d’antennes et amplifiaient le signal.

- Des chercheurs découvrent 49 failles de sécurité dans le secteur automobile

- Instructions non documentées dans le microcontrôleur Bluetooth Espressif – mise à jour

Cependant, il est relativement facile de palier à ces vulnérabilités. En changeant l’emplacement des microphones MEMS dans les ordinateurs portables, on pourrait éviter les longs câbles qui amplifient les fuites radio. Une modification de la fréquence d’horloge du traitement audio de 1 % a également réduit l’intelligibilité des signaux sans avoir d’incidence sur les performances, de sorte que les chercheurs recommandent l’utilisation d’une horloge à spectre étalé comme moyen de défense.

www.usenix.org/conference/usenixsecurity25/presentation/onishi

Si vous avez apprécié cet article, vous aimerez les suivants : ne les manquez pas en vous abonnant à :

ECI sur Google News

Si vous avez apprécié cet article, vous aimerez les suivants : ne les manquez pas en vous abonnant à :

ECI sur Google News